Inteligența artificială, în centrul unui conflict militar. Hegseth cere acces total la modelul Claude

- Iulia Moise

- 25 februarie 2026, 10:54

Claude, Pentagon / sursa foto: Chat GPT

Claude, Pentagon / sursa foto: Chat GPT

Secretarul american al apărării, Pete Hegseth, a transmis marți un ultimatum start-up-ului californian Anthropic, solicitând eliminarea tuturor restricțiilor legate de utilizarea modelului său de inteligență artificială de către Departamentul Apărării al Statelor Unite, potrivit Reuters.

Compania are termen până vineri, ora 24:00 (ora României), pentru a se conforma solicitării. În caz contrar, oficialul american a indicat că ar putea invoca o lege adoptată în 1950, care permite guvernului să oblige o companie privată să producă bunuri considerate necesare pentru apărarea națională.

Solicitarea lui Pete Hegseth și cadrul legal invocat

Conform sursei citate, poziția exprimată de Pete Hegseth subliniază intenția Pentagonului de a extinde aria de utilizare a sistemelor AI furnizate de partenerii săi contractuali.

Dacă Anthropic nu va da curs solicitării, șeful Pentagonului ia în calcul inclusiv includerea companiei pe lista entităților considerate „un risc pentru aprovizionare”.

Companiile înscrise pe această listă sunt supuse unor restricții semnificative în ceea ce privește accesul la contracte guvernamentale.

Lista respectivă este utilizată, în general, pentru firme ale căror produse sunt suspectate că ar putea afecta securitatea națională a Statelor Unite. În prezent, pe listă figurează în principal companii străine, printre care Huawei și Kaspersky.

Întâlnirea dintre oficialii americani și conducerea Anthropic

Ultimatumul a fost formulat după o întâlnire desfășurată marți între Pete Hegseth și directorul executiv al Anthropic, Dario Amodei. Discuțiile au vizat restricțiile menținute de companie asupra modelului său AI, Claude, în contextul utilizării de către Pentagon.

Pentagonul a cerut furnizorilor de inteligență artificială să elimine limitările implicite ale modelelor, cu condiția ca utilizările să rămână în limitele legii.

Deși majoritatea companiilor ar fi acceptat cererea, Anthropic a dorit să mențină două interdicții explicite privind Claude: utilizarea pentru supravegherea în masă a populației și automatizarea unui atac mortal.

Referitor la aceste preocupări, responsabilul american a declarat: „Nu are nimic de-a face cu supravegherea în masă și utilizarea armelor autonome”.

Reacția Anthropic la ultimatumul lui Pete Hegseth

Anthropic a confirmat continuarea dialogului cu autoritățile americane. Un purtător de cuvânt al companiei a precizat:

„Continuăm discuțiile noastre de bună-credință cu privire la utilizările (AI)”. Potrivit acestuia, obiectivul este de a „asigura că Anthropic poate continua să susțină misiunea de securitate națională a guvernului, în conformitate cu ceea ce modelele noastre pot realiza în mod responsabil și fiabil”.

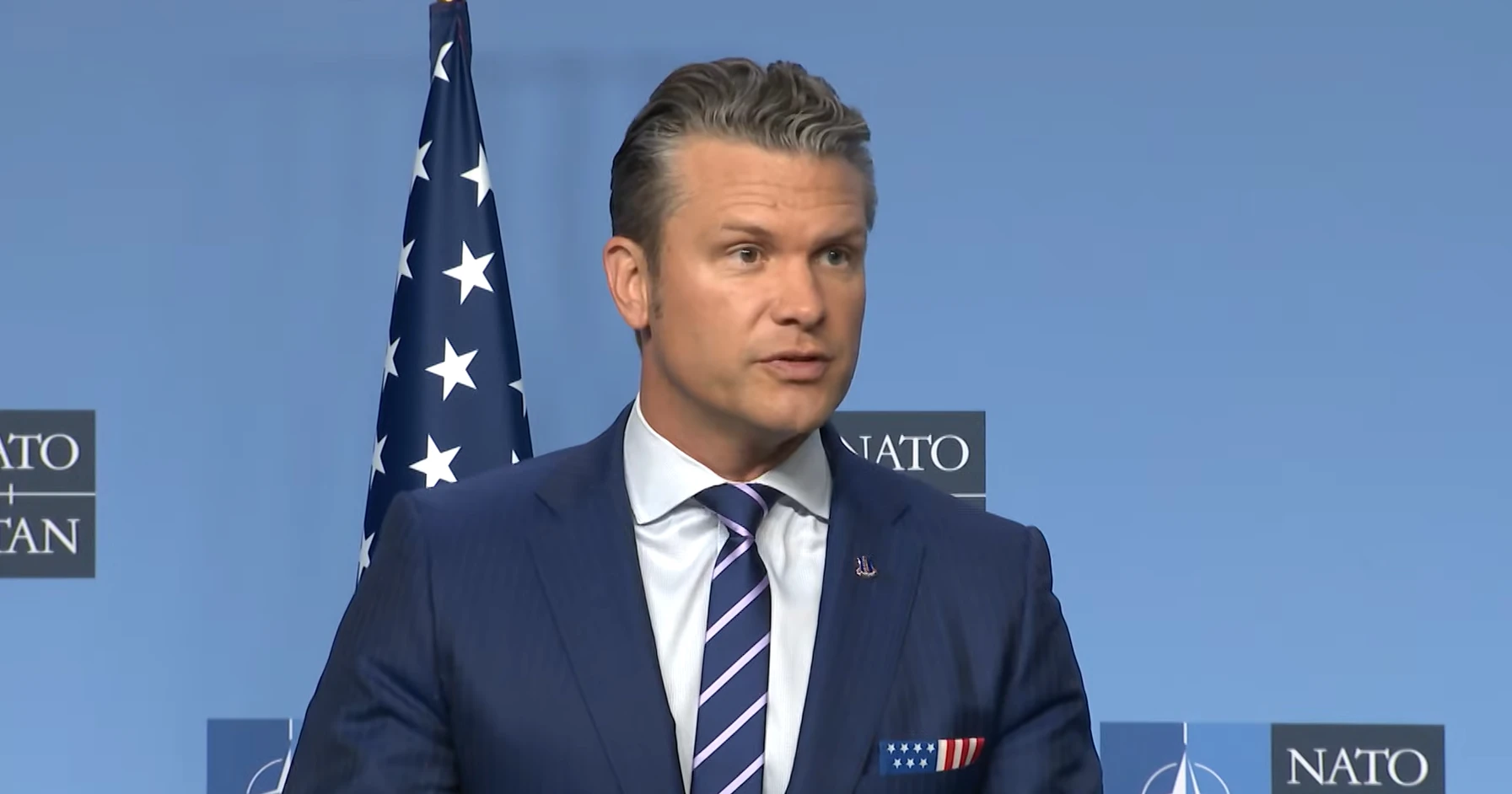

Pete Hegseth. Sursa foto: Captură video Youtube

Compania, fondată în 2021 de foști angajați ai OpenAI, a susținut în mod constant o abordare orientată spre siguranță și utilizare responsabilă a inteligenței artificiale.

Contextul politicii etice promovate de Anthopic

La începutul anului 2026, Anthropic a publicat un document denumit „Constituție”, care stabilește un set de principii și instrucțiuni menite să ghideze comportamentul modelului Claude. Documentul vizează, între altele, „prevenirea acțiunilor cu un grad de pericol inadecvat”.

Această poziționare a companiei reflectă dezbaterea mai largă privind echilibrul dintre nevoile de securitate națională și limitările etice ale utilizării inteligenței artificiale, în special în domeniul militar.