Lumea piere, iar experții vor să afle dacă e etic să ucidem roboții

- Iuliu Vlădescu

- 1 noiembrie 2020, 07:11

În serialul „Star Trek: The Next Generation” , episodul„The Measure of a Man”, Data, un membru android al navei Enterprise, urmează să fie demontat, pentru a fi cercetat.

Salvarea lui vine de la căpitanul Picard, care spune că Data are aceleași drepturi ca o ființă umană. Aici apare întrebarea firească: Pe ce bază un anumit lucru are drepturi și ce conferă unei entități o poziție morală?, potrivit NationalInterest.

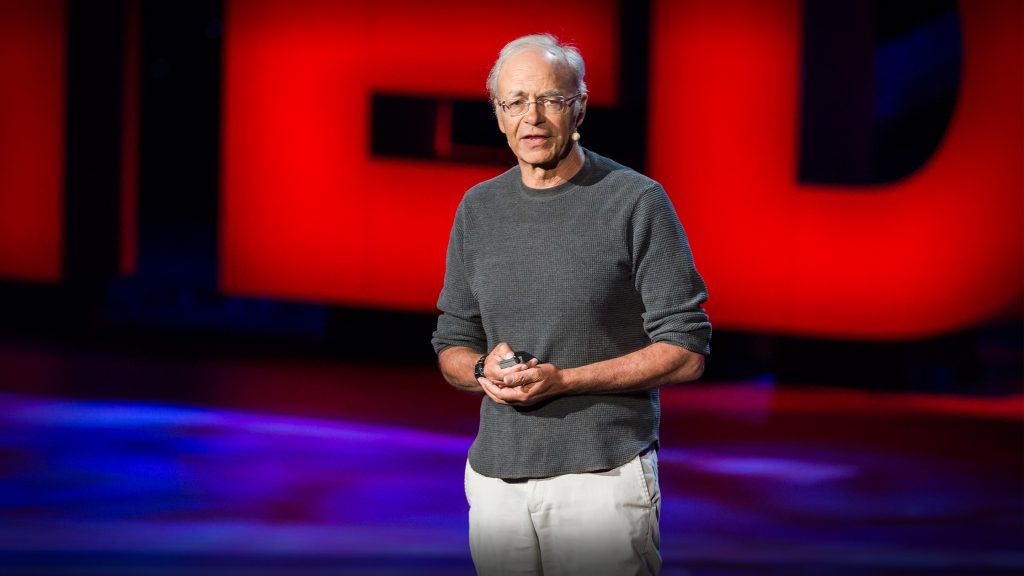

Filosoful Peter Singer susține că toate creaturile care pot simți durere sau suferă pot revendica poziția morală. El susține că animalele au o poziție morală, deoarece pot simți durere și suferință, iar limitarea acesteia la oameni ar fi o formă de specism.

Pe măsură ce tehnologiei inteligenței artificiale avansează spre versiunile imaginate de Hollywood, problema poziției morale devine tot mai importantă. Dacă AI are o poziție morală, s-ar putea spune că au dreptul la viață. Computerul Deep Blue al celor de la IBM a fost antrenat cu succes pentru a-l învinge pe marele maestru Gary Kasparov. Nimic altceva. Acest computer avea ceea ce se numește „inteligență specifică domeniului”.

Pe de altă parte, există un fel de inteligență care permite capacitatea de a face mai bine o varietate de lucruri. Se numește inteligență generală a domeniului. Și este ceea le permite oamenilor să gătească, să schieze și să crească copii.

Inteligența generală artificială, AGI, este termenul pentru mașinăriile care au inteligență generală de domeniu. Probabil că nici o mașină nu a demonstrat încă acest tip de inteligență. În această vară, un startup numit OPENAI a lansat o nouă versiune a modelului Generative Pre-Training. GPT-3 este un sistem de procesare a limbajului natural, instruit să citească și să scrie astfel încât să poată fi ușor de înțeles de către oameni.

A atras atenția imediat datorită capacității sale impresionante de a imita artificiile stilistice. În ciuda acestei performanțe impresionante, GPT-3 nu știe însă nimic despre cum să asocieze cuvinte în diferite moduri.

Conștiința are două părți. O dată ar fi conștiință fenomenală, adică modul în care experimentați un fenomen, cum ar fi mirosul unui trandafir sau senzația de durere.

În contrast, există și conștiință de acces. Este capacitatea de a raporta, de a raționa, de a se comporta și de a acționa în mod coordonat și receptiv la stimuli pe baza obiectivelor.

Data din Star Treck este însă un android. Cum poate face el aceste distincții? Data demonstrează că e conștient de sine prin faptul că poate monitoriza dacă, de exemplu, este încărcat optim sau dacă există daune la brațul său robotizat. Însă îi lipsește conștiința fenomenală. El nu se bucură de parfumul trandafirilor și nu cunoaște durerea.

Dar ce spuneți de Skynet din seria „Terminator” sau de temerile exprimate de Elon Musk cu privire la faptul că AI este mai periculoasă decât armele nucleare. Sau de Stephen Hawking, care avertiza că AI poate pune capăt omenirii?

Nu se poate spune automat că doar pentru că AI acționează împotriva intereselor umanității sau a altei inteligențe artificiale nu are o poziție morală. Dacă statutul moral este dat în virtutea capacității de a suferi, atunci Skynet și Data pot beneficia de acest statut, chiar dacă doar Data vrea să ajute ființele umane.

Modul în care umanitatea alege să răspundă la întrebarea privind poziția morală pentru creaturile nonbiologice va avea implicații mari asupra modului în care ne ocupăm de viitorii roboți, indiferent dacă sunt amabili și de ajutor, cum ar fi Data, sau creați pentru distrugere, cum ar fi Skynet.